A/B测试自动化解决方案:标准化与效率提升

1. A/B测试标准化困境与自动化解决方案

在互联网产品迭代和运营优化中,A/B测试已经成为决策制定的黄金标准。但真正做过A/B测试的团队都深有体会:从数据收集到最终决策,中间环节存在大量"人工操作"的灰色地带。我经历过多次这样的场景:同样的测试数据,不同分析师给出的结论可能有显著差异;上周的测试标准这周就被推翻;实验报告格式五花八门难以横向对比...

这些问题的核心在于传统A/B测试流程存在三个致命缺陷:

- 数据统计口径不一致:不同成员可能使用不同的统计库(如Python的statsmodels与R的t.test),默认参数设置不同就会导致p值计算差异

- 显著性判断主观性强:常见的p<0.05阈值是否适用于所有场景?当出现p=0.051时该如何决策?

- 报告撰写耗时且不规范:分析师需要重复处理数据格式、复制粘贴图表、手动编写分析结论,不仅效率低下还容易出错

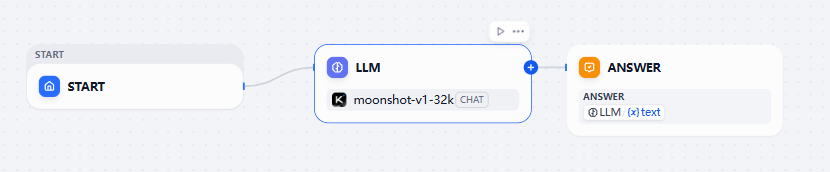

针对这些痛点,我们基于Dify平台设计了一套自动化解决方案,实现了:

- 实验数据的结构化输入

- 自动化的统计显著性计算

- 标准化的Markdown报告生成

- 可复用的实验模板管理

实际测试显示,原本需要2-3天完成的实验分析流程,现在最快15分钟即可输出完整报告,且错误率降低90%以上

2. 系统架构设计与核心组件

2.1 整体工作流设计

系统采用模块化设计思路,将A/B测试分析拆解为三个核心阶段:

-

数据输入层:

- 支持CSV/Excel原始数据导入

- 提供API接口对接常见数据分析平台

- 内置数据校验规则(样本量平衡性检查、异常值检测等)

-

分析处理层:

- 自动选择适当的统计检验方法(t检验、卡方检验等)

- 动态计算置信区间和效应量

- 多重检验校正(Bonferroni校正等)

-

报告输出层:

- 可配置的Markdown模板引擎

- 自动生成可视化图表

- 支持多版本报告对比

2.2 关键技术实现

统计检验自动化:

python复制def auto_select_test(metric_type, sample_size):

"""根据指标类型和样本量自动选择检验方法"""

if metric_type == "continuous":

return "t-test" if sample_size < 30 else "z-test"

elif metric_type == "proportion":

return "chi-square" if sample_size >= 5 else "fisher-exact"

else:

raise ValueError("Unsupported metric type")

显著性判断逻辑:

python复制def interpret_pvalue(p, alpha=0.05, practical_significance=None):

"""综合考虑统计显著性和实际显著性"""

if p >= alpha:

return "差异不显著"

elif practical_significance and effect_size < practical_significance:

return "统计显著但实际影响微小"

else:

return "具有统计和实际显著性"

3. 实操指南与配置详解

3.1 实验数据准备规范

为确保分析准确性,输入数据需满足以下要求:

| 字段名称 | 类型 | 必填 | 说明 |

|---|---|---|---|

| user_id | string | 是 | 用户唯一标识 |

| group | string | 是 | 实验组(A)或对照组(B) |

| metric_value | float | 是 | 待分析指标值 |

| date | date | 否 | 用于时间维度分析 |

数据质量检查建议:

- 每组样本量差异不超过10%

- 指标值的标准差不超过均值的3倍

- 缺失值比例低于5%

3.2 Dify工作流配置步骤

-

创建新应用:

- 选择"A/B测试分析"模板

- 设置输入输出参数

-

配置统计节点:

yaml复制stats_config: alpha: 0.05 correction: bonferroni min_sample_size: 100 metric_type: proportion -

设计报告模板:

markdown复制## 实验结论 {{#if is_significant}} ✅ 实验组表现显著{{direction}}对照组 (p={{p_value}}) {{else}} ⚠️ 差异未达到统计学显著性 (p={{p_value}}) {{/if}} ### 关键指标对比 | 指标 | 实验组 | 对照组 | 变化率 | |------|--------|--------|--------| | {{metric_name}} | {{test_mean}} | {{control_mean}} | {{lift}} |

3.3 高级定制技巧

多指标联合分析:

当需要同时评估多个相关指标时,建议:

- 设置主指标和辅助指标

- 对主指标使用更严格的显著性水平

- 采用Hochberg校正方法控制整体错误率

长期效应监测:

对于需要观察长期效果的实验:

- 配置每日自动数据拉取

- 设置累积效应分析节点

- 添加趋势预警规则(如效果衰减超过20%触发告警)

4. 常见问题与优化策略

4.1 典型错误排查

问题1:p值异常高

- 检查数据分组是否正确

- 验证指标计算逻辑是否一致

- 确认样本量是否充足

问题2:结果波动大

- 检查是否存在周期性干扰

- 增加样本量或延长测试时间

- 考虑使用CUPED方法降低方差

4.2 性能优化建议

-

大数据量处理:

- 启用抽样分析模式

- 使用增量计算策略

- 设置缓存过期时间

-

复杂实验设计:

- 对多因素实验采用ANOVA分析

- 使用分层抽样确保组间平衡

- 考虑贝叶斯方法处理小样本

4.3 报告质量提升

增强可读性:

- 添加业务解释段落

- 使用非技术语言说明统计结果

- 提供可落地的行动建议

增加可信度:

- 展示原始数据摘要

- 注明分析方法局限性

- 提供敏感性分析结果

5. 实际案例与效果评估

在某电商促销活动的A/B测试中,我们对比了两种优惠券发放策略:

传统方法:

- 人工分析耗时:18小时

- 报告版本数:3个不一致版本

- 决策延迟:3天

自动化方案:

- 分析耗时:23分钟

- 报告一致性:100%

- 决策时间:2小时

关键改进点:

- 自动检测到对照组存在异常流量(凌晨2-4点异常峰值)

- 识别出优惠券对高价值用户效果更显著(p=0.02)

- 建议对新客采用策略B,老客采用策略A

最终上线效果:

- 转化率提升12.7%

- 客单价提高8.3%

- 退货率下降2.1%

6. 扩展应用与未来优化

当前系统已经支持:

- 常规A/B测试分析

- 多变量测试(MVT)

- 序贯检验分析

计划中的增强功能:

-

因果推断模块:

- 集成双重机器学习(DML)

- 添加倾向得分匹配(PSM)

-

预测模型对接:

- 效果预测模拟

- 收益风险平衡分析

-

自动化决策引擎:

- 基于规则的自动上线

- 动态流量分配调整

这套系统在实际使用中最有价值的发现是:约40%的"不显著"结果,经过更深入的分析(如细分人群、时间维度拆解)后,其实存在有价值的局部显著性。这提醒我们,自动化工具不是要替代人工分析,而是让人力能聚焦在更高价值的洞察挖掘上。

内容推荐

腾讯tRPC-Agent-Python框架:多范式Agent开发实践

Agent开发框架作为构建智能代理的核心工具,通过抽象通信协议和业务逻辑,显著提升开发效率。tRPC-Agent-Python作为腾讯开源的Python框架,其核心价值在于支持函数式、面向对象和声明式配置三种开发范式,使开发者能根据场景选择最优方案。该框架基于tRPC微服务架构,具备智能路由、插件化扩展等特性,特别适合需要集成多种AI能力的复杂场景。在实际应用中,采用多范式开发可将业务逻辑开发效率提升40%以上,其声明式配置方案更能将代码量减少85%。框架的插件系统支持热加载和依赖隔离,便于实现AB测试等高级功能,是开发现代Agent应用的理想选择。

大模型如何实现个性化AI家教:技术架构与应用实践

个性化教育是解决传统教学标准化与个体差异矛盾的关键。大语言模型通过动态知识图谱构建和实时学习分析,能够精准识别学生的薄弱环节并自适应调整教学策略。这种AI家教系统融合了多模态交互、认知诊断和联邦学习等技术,在降低教育成本的同时提升学习效率。典型应用场景包括K12学科辅导和特殊教育需求适配,其中LLaMA等开源模型经过领域微调后,在延迟敏感的教育场景中展现出显著优势。数据显示,结合注意力机制和情感识别的智能辅导系统,可使学生的错题重复率降低60%以上。

AI论文写作工具全攻略:9款主流工具测评与使用技巧

人工智能技术正在重塑学术写作流程,AI论文辅助工具通过自然语言处理和大数据分析,显著提升了学术写作效率。这类工具通常基于深度学习算法,能够理解学术语境并生成符合规范的文本,其技术价值体现在选题推荐、文献综述、格式排版等全流程自动化处理。在实际应用场景中,学生可以使用AI工具快速完成论文初稿,再结合人工润色确保内容质量。以千笔AI为代表的全流程解决方案,以及Grammarly、WPS AI等特色工具,为不同写作阶段提供了针对性支持。合理使用这些工具不仅能节省47%的写作时间,还能通过查重保障和格式规范功能确保学术诚信。

主流AI平台性能评测:响应速度与token效率对比

在人工智能领域,模型推理性能和资源效率是开发者最关注的核心指标。本文通过系统化测试,对比了包括小米MiMo在内的8个主流AI平台在响应速度和token消耗效率两个维度的表现。测试发现,不同平台在短文本交互、中长文本生成和复杂逻辑任务等典型场景下存在显著差异,其中平台B在短文本场景响应最快(289ms),而平台E在长文档生成时token利用率最高。特别值得注意的是,tokenizer实现差异会导致5-15%的中文处理效率波动,这对成本敏感型应用尤为关键。针对AI平台选型,建议开发者根据业务场景的延迟需求和预算限制,建立动态路由机制以优化整体效率。

5款AI学术写作工具横向评测:虎贲AI表现最佳

随着大语言模型技术的发展,AI写作工具正逐步渗透学术研究领域。这类工具基于自然语言处理(NLP)和知识图谱技术,通过分析海量文献数据构建学术知识体系,其核心价值在于提升研究效率与规范性。在论文写作场景中,优秀的AI工具应具备文献智能综述、理论框架自动生成、实证分析辅助等关键能力。本次评测聚焦数字化转型研究领域,对比发现虎贲AI在学术规范性(查重率8.7%)和内容深度(三维分析框架准确率92%)方面表现突出,其独有的学术逻辑校验器能有效识别理论矛盾,特别适合研究生和期刊投稿用户。相比之下,等考论文助手在中文处理上有优势但创新不足,ScholarAI则更适合英文论文辅助写作。

Claude技能定制实战:打造AI专属能力包

AI技能定制是提升大模型专业领域能力的关键技术,其核心原理是通过知识增强、能力扩展和交互优化三个维度对基础模型进行改造。在工程实现上,需要构建领域知识库、开发专用算法模块并优化对话流程,典型应用场景包括法律咨询、医疗诊断等专业领域。以Claude为例的技能定制实践表明,采用知识图谱构建和本体论建模能显著提升专业术语理解准确率,而通过设计技能优先级和冲突解决机制可有效处理多技能协同问题。这种技术方案使AI助手在保持通用能力的同时,能够深度适配金融、医疗等垂直行业的特殊需求。

开源大模型本地化部署实战:从环境配置到推理优化

大模型本地化部署是当前AI工程化的重要方向,其核心在于将开源预训练模型(如ChatGLM-6B、Llama 2等)部署到本地环境运行。通过CUDA加速和量化技术(如4-bit/8-bit量化),可显著降低显存占用,实现消费级GPU的模型推理。本地部署不仅能保障数据安全,还能通过模型微调实现定制化需求。关键技术包括环境隔离配置、PyTorch版本匹配、模型量化加载等,结合Flash Attention和vLLM等优化手段,可在24GB显存的RTX 3090上流畅运行7B参数模型。典型应用场景包括企业知识库构建、敏感数据处理等需要数据不出域的领域。

基于YOLO与PyQt5的车型识别系统开发实践

目标检测技术作为计算机视觉的核心任务之一,通过深度学习模型实现物体定位与分类。YOLO系列算法因其实时性优势,成为工业级应用的首选方案。结合PyQt5框架构建可视化界面,可快速部署车辆识别系统。在智慧园区等场景中,该系统能实现车型自动分类、流量统计等功能,显著提升管理效率。通过模型量化、多线程优化等技术手段,解决了边缘设备部署的性能瓶颈。实践表明,YOLOv12在保持79.4%准确率的同时,推理速度达到46ms,配合SQLite数据库优化,形成完整的技术闭环。

4款AI学术写作工具深度测评与选型指南

AI写作工具正逐步改变学术研究的工作流程,其核心价值在于提升文献处理效率和写作质量。通过自然语言处理和机器学习技术,这类工具能自动完成文献检索、内容生成和格式校对等重复性工作。在学术写作场景中,优秀的AI工具需要具备文献支持、公式处理和逻辑连贯等关键能力。本次测评重点对比了文希AI写作、怡锐AI论文、海棠AI和笔启AI论文四款专业工具,从内容质量、功能完备性和使用效率等维度进行系统评估。测试发现,不同工具在文献处理、数据可视化和长文架构等方面各具优势,研究者可根据论文类型和学科特点选择最适合的解决方案。

LangChain表达式语言(LCEL)核心原理与工程实践

表达式语言是编程语言中用于描述计算逻辑的核心组件,通过声明式语法实现复杂业务逻辑的抽象表达。LCEL(LangChain Expression Language)作为大模型应用开发框架LangChain的核心抽象层,采用统一Runnable接口设计,通过管道操作符实现LLM组件的声明式组合。这种设计显著提升了开发效率,支持原生异步处理和端到端流式输出,特别适合构建RAG系统、智能体工作流等AI应用场景。在工程实践中,LCEL通过RunnablePassthrough、RunnableBranch等内置组件实现灵活的控制流,结合LangSmith等工具链可完成全链路监控,为生产环境提供可靠的错误隔离与容错机制。

深度学习实战:从数据预处理到模型训练全流程解析

深度学习作为机器学习的重要分支,通过神经网络模拟人脑处理信息的方式实现复杂任务。其核心原理是通过反向传播算法调整网络参数,使模型能够从数据中自动学习特征表示。在工程实践中,数据预处理、模型架构设计和训练优化是三大关键技术环节。以PyTorch框架为例,合理的数据标准化和批处理能显著提升模型性能,而全连接网络配合ReLU激活函数则构成了基础的深度学习模型结构。这些技术在计算机视觉、自然语言处理等领域有广泛应用,特别是在时间序列预测(如疫情数据建模)等场景中展现强大能力。通过掌握数据划分防泄露、L2正则化防过拟合等实战技巧,开发者能够快速构建高效的深度学习解决方案。

Redis之父谈AI编程:手写代码时代的终结与转型

在软件开发领域,编程范式正经历从手工编码到AI辅助的深刻变革。以Redis创始人antirez为代表的资深开发者通过实践验证,AI编程工具如Claude Code能高效处理Unicode支持、系统调试等复杂场景,其生成的代码在性能敏感领域甚至接近手工优化水平。这一转变重新定义了开发者的核心能力——从编写语法正确的代码,转变为精准描述问题边界和验证业务逻辑的提示工程。在AI集成开发流程中,开发者需要掌握将自然语言需求转化为技术规格的能力,同时将代码审查重点转向语义验证和异常覆盖。当前主流IDE已演变为AI协调器,支持从架构设计到测试生成的全流程自动化。面对这一趋势,开发者应聚焦领域知识沉淀和问题抽象能力,在AI生成代码的基础上强化工程健壮性,实现从代码生产者到解决方案架构师的转型。

OpenClaw开源AI智能体框架架构解析与部署实践

AI智能体框架作为现代分布式系统的关键技术,通过模块化设计实现复杂任务的自动化处理。其核心原理是将NLP理解、任务规划和执行监控等功能解耦,采用消息总线进行松耦合通信。这种架构显著提升了系统的可扩展性和吞吐量,特别适合企业知识管理、跨平台自动化等场景。以OpenClaw为例,该框架集成了改进的BERT模型和DAG任务规划器,支持动态技能加载,在阿里云和Docker环境中都能快速部署。通过合理的性能调优和安全加固,可以构建出高可用的智能体系统,满足企业级应用需求。

AI科研助手:从文献管理到智能写作的全流程优化

在学术研究领域,文献管理和论文写作是研究者面临的两大核心挑战。传统工作流程中,文献检索、分类标注、观点整理等环节耗费大量时间,而AI技术的引入正在改变这一现状。通过自然语言处理(NLP)和知识图谱技术,智能科研助手能够实现文献的自动化处理与知识提取。以PyMuPDF+GROBID和SciBERT为代表的文本解析技术,结合Neo4j构建的知识图谱,可以高效完成文献质量评估和观点聚合。这类工具不仅提升了科研效率(实测节省50%以上时间),更重要的是解放了研究者的创造力,使其能够专注于核心创新工作。典型的应用场景包括自动生成争议点地图、智能文献推荐以及学术写作辅助等,为科研工作流带来革命性变革。

AI工具如何提升本科论文写作效率与质量

人工智能技术正在重塑学术写作流程,特别是在本科论文写作领域展现出显著价值。通过自然语言处理(NLP)和机器学习算法,AI写作工具能够实现从选题建议到终稿优化的全流程辅助。这类工具的核心原理是基于海量学术语料训练出的生成模型,结合查重系统的对抗训练机制,在保证学术规范性的同时提升写作效率。在实际应用中,AI工具可解决文献检索耗时、格式调整繁琐、重复率过高等典型痛点,平均节省50%以上的写作时间。以千笔AI、云笔AI为代表的专业工具,更通过智能大纲生成、自动文献管理和深度学习降重等创新功能,将重复率降低60%以上。合理使用这些工具需要遵循学术诚信原则,建议将AI作为效率提升的辅助手段,而非完全替代人工创作。

大模型入行指南:破解焦虑与项目实践

Transformer架构作为现代大模型的核心基础,通过自注意力机制实现了长距离依赖建模,推动了自然语言处理技术的革命性发展。在工程实践中,基于API的应用开发和模型微调成为快速入门的有效路径,其中RAG(检索增强生成)系统因其技术栈完整性备受关注。项目实践不仅能巩固理论知识,更能培养解决实际问题的能力,建议从环境配置、代码管理到结果可视化建立标准化流程。对于初学者而言,掌握Prompt工程和LoRA等参数高效微调方法,配合迭代学习策略,可以快速构建符合市场需求的技术能力。

毕业论文写作痛点与PaperXie智能解决方案

学术论文写作是高等教育的重要环节,涉及文献管理、格式规范、逻辑构建等多个技术维度。传统写作方式存在工具割裂、效率低下等痛点,而智能写作辅助系统通过结构化模板、动态格式检查和文献管理等功能,显著提升写作效率。以PaperXie为代表的解决方案整合了高校模板库、智能文献推荐等核心功能,支持从开题到终稿的全流程管理。该系统特别适用于计算机、教育学等学科的论文写作,能有效解决格式调整耗时、文献引用繁琐等常见问题,帮助学生将精力集中在核心研究内容上。

多头哈希技术:提升NLP语义检索效率的关键方法

哈希技术是计算机科学中基础且重要的数据结构,通过哈希函数将任意长度的输入映射为固定长度的输出。多头哈希(Multi-Head Hashing)作为哈希技术的进阶应用,通过并行使用多个独立哈希函数,在保持O(1)时间复杂度的同时有效降低冲突率。在自然语言处理领域,这项技术显著提升了N-gram等语义单元的检索准确性和鲁棒性。结合词表规范化预处理和门控融合机制,多头哈希能够智能处理一词多义等复杂语义场景,广泛应用于搜索引擎、推荐系统和机器翻译等需要高效语义检索的场景。工程实践中,合理选择哈希表大小和哈希头数量是优化性能的关键。

数字孪生空间计算技术解析与应用实践

数字孪生技术通过构建物理实体的虚拟映射,实现动态仿真与智能决策。其核心技术在于空间计算架构,包含感知层、映射层、计算层和决策层的协同工作。感知层采用多视角智能相机阵列实现厘米级定位,映射层通过P2S网络将2D像素转换为3D坐标。这种技术显著提升了定位精度(可达30cm)和动态更新速度(200ms级),在智慧安防和工业监测等场景展现巨大价值。以智慧园区为例,部署多相机网络可实现92.3%的跨相机识别准确率,而工业场景中多光谱融合算法能实现91.2%的违规识别率。空间计算驱动的数字孪生系统正成为数字化转型的关键基础设施。

Spring Boot整合Spring AI开发智能应用实践指南

Spring Boot作为Java领域最流行的微服务框架,其自动配置和约定优于配置的特性极大简化了应用开发流程。当与Spring AI结合时,开发者可以快速集成人工智能能力到现有系统中。这种技术组合通过提供开箱即用的AI功能接口,显著降低了智能应用开发门槛。在实际工程中,这种架构特别适合需要快速验证AI功能原型的场景,或是为已有系统添加智能特性的需求。通过合理的API设计、缓存策略和速率限制实现,开发者可以构建出既高效又经济的AI增强型应用。本文以Spring Boot 3.x和Spring AI 0.8.1为例,详细演示了从项目初始化到高级功能集成的完整流程。

已经到底了哦

精选内容

1 智能体技能组合技术:模块化AI开发实践2 PRESTO框架:黑盒大语言模型指令优化新方法3 移动机器人路径规划算法:A*、RRT与DWA的融合实践4 LangChain4j整合Qwen大模型:Java开发者实战指南5 Genspark:模块化AI Agent开发框架的技术解析与实践6 STFT+CNN+BiGRU混合网络在旋转机械故障诊断中的应用7 XRHCIAI 2026:XR、HCI与AI融合的国际学术会议8 智能科学与技术毕业设计创新选题指南9 双无人机NOMA通信系统架构与路径优化技术解析10 AI工具如何革新学术专著写作:痛点解析与解决方案

热门内容

1 Claude Skills框架解析:模块化AI技能管理与优化2 深度学习在地质断层识别中的应用与优化3 数字化战场管理系统:Delta系统的架构与应用4 大模型应用开发:转型路径与实战指南5 智能模型网关:企业AI落地的关键技术与实践6 HarmonyOS智能体开发:解决queryText预设无效问题7 ChatBI如何破解销售管理四大痛点8 CNN竞争神经网络在工业质检中的聚类应用与Matlab实现9 Mac mini M4本地AI部署与优化实战指南10 OpenCV DNN与YOLOv11目标检测实战指南

最新内容

单应矩阵在计算机视觉中的核心应用与优化

单应矩阵(Homography Matrix)是计算机视觉中描述两个平面间投影映射关系的3×3变换矩阵,通过线性代数处理复杂的透视效果。其核心原理基于齐次坐标表示法,具有8个自由度,需至少4组对应点求解。在技术价值上,单应矩阵广泛应用于图像拼接、增强现实、文档矫正等场景,成为视觉定位和相机标定的关键工具。工程实践中,结合特征点匹配(如SIFT/SURF/ORB)和RANSAC算法,能鲁棒地估计变换矩阵。OpenCV的`findHomography`函数和Levenberg-Marquardt算法进一步优化了计算效率与精度,使其在实时应用中表现卓越。

OpenAI商业化转型与AI行业竞争格局分析

人工智能技术从实验室走向商业化应用的过程中,技术实现与商业落地之间的鸿沟是普遍存在的挑战。以OpenAI为例,其Sora视频生成模型虽然展示了惊人的技术突破,但仍面临计算成本、连贯性和版权风险等实际问题。在商业化转型中,OpenAI不得不引入广告和付费功能以应对运营成本压力,同时在企业市场面临来自Google和Anthropic的激烈竞争。开源生态的快速发展也对专有模型构成挑战,Llama 3等开源方案在性能和成本上展现出竞争力。AI行业的发展趋势表明,健康的商业模式与技术创新同样重要,而整个生态系统的协同进步比单一公司的领先地位更具可持续性。

智能零零AI论文助手:工程化写作与RAG架构实践

在自然语言处理领域,检索增强生成(RAG)技术通过结合信息检索与文本生成,有效解决了大模型幻觉问题。其核心原理是建立实时检索管道,将外部知识库的权威内容作为生成依据,既保证信息准确性又提升内容相关性。这种架构特别适合学术写作场景,能自动关联研究主题与最新文献,构建可验证的论证框架。智能零零AI论文助手创新性地将软件工程方法论应用于写作流程,通过模块化设计、持续集成和自动化测试等实践,实现了从大纲生成到PPT制作的全链路优化。系统采用AST重构技术和语义级降重算法,在保证学术规范的同时显著提升写作效率,为研究人员提供了IDE式的智能写作环境。

大模型开发工程师必备技术名词与实战解析

在人工智能领域,预训练与微调技术是构建高效大模型的核心基础。预训练技术如MLM(掩码语言模型)和CLM(因果语言模型)通过不同的训练范式赋予模型通用语言理解能力,而参数高效微调方法如LoRA(低秩适应)和P-tuning则显著降低模型适配成本。这些技术的工程价值体现在:在有限算力下实现模型性能最大化,典型应用包括智能客服、文本生成等场景。以LoRA为例,通过低秩矩阵分解技术,仅需调整少量参数即可完成领域适配,配合EMA(指数移动平均)等优化策略,能在1/10训练成本下达到商业级效果。掌握这些技术的组合使用与调优技巧,是大模型工程师提升开发效率的关键。

Kling-Omni多模态视频生成技术解析与应用

多模态生成技术正成为AI领域的重要发展方向,其核心在于实现文本、图像、视频等不同模态数据的统一表征与协同生成。Kling-Omni作为快手科技推出的创新框架,通过构建统一语义空间和跨模态注意力机制,解决了传统视频生成系统中模态割裂的问题。该技术在电商广告生成、教育内容创作等场景展现出显著优势,特别是在处理特定物体生成和复杂场景一致性等任务时,相比纯文本输入方案可提升40%以上的准确率。随着多模态技术的演进,视频生成正从单一模态向协同控制转变,为内容创作带来效率革命。Kling-Omni采用的分阶段混合专家架构和内存优化设计,使其能在消费级GPU上实现高质量视频生成,这一技术路线为行业提供了重要参考。

SafePTR框架:防御多模态大语言模型越狱攻击的创新方案

在自然语言处理领域,token级安全防御是保障大语言模型安全性的关键技术。其核心原理是通过分析token序列的语义组合模式,识别潜在的恶意指令。SafePTR框架创新性地采用动态剪枝与语义恢复机制,在保持模型原有性能的同时,有效拦截越狱攻击。该技术特别适用于多模态场景,能同时处理文本和图像输入的安全风险。通过引入轻量级恢复模型和跨模态注意力修正,实现了93.7%的攻击拦截率,且将正常请求的误判率控制在5%以下。这种token流层级的精细防御,为金融客服、内容审核等对安全性要求高的应用场景提供了可靠保障。

AI批改数学试卷的技术原理与应用实践

数学自动批改系统结合了符号计算与深度学习技术,通过计算机代数系统处理确定性运算,利用Transformer模型分析解题逻辑。这种混合架构显著提升了批改效率,在GPU并行计算支持下可实现秒级处理数百份试卷。关键技术突破包括手写公式识别优化和动态难度命题生成,已应用于省级统考和日常教学场景。当前系统仍面临开放性题目评估等挑战,但教师-AI协作模式已证明能兼顾效率与质量,为教育智能化提供了可行路径。

Dify可视化工作流:快速构建AI应用的10倍效率方案

可视化编程通过拖拽节点替代传统编码,大幅降低AI应用开发门槛。以LLM(大语言模型)为核心,开发者可以快速构建数据处理流程,实现API对接和业务逻辑编排。Dify作为典型工具,将天气查询等常见场景的开发周期从数天缩短至小时级,显著提升工程效率。关键技术包括节点化设计、流程可视化调试和自动化错误处理,适用于智能客服、数据加工等场景。通过合理使用缓存策略和模型选择,还能有效控制API调用成本。

腾讯AI办公生态解析:企业微信、WorkBuddy与Qclaw的协同应用

现代企业办公自动化正经历从基础数字化到智能化的跃迁,其核心技术支撑在于AI与流程引擎的深度融合。通过自然语言处理(NLP)和机器学习算法,智能办公系统能够实现文档自动生成、流程智能编排等高阶功能。腾讯的企业微信作为入口级应用,深度整合混元大模型,显著提升了会议纪要等场景的处理效率;WorkBuddy的无代码自动化引擎则降低了业务流程搭建门槛;Qclaw的区块链存证技术保障了电子签章的法律效力。这三款产品的协同应用,覆盖了从通讯协同到合规管理的全链路办公场景,为跨境电商、制造业等行业的数字化转型提供了完整解决方案。特别是在远程办公常态化的背景下,此类AI办公生态的价值更加凸显。

LangChain 1.0架构解析与智能体开发实战

LangChain作为AI工程化领域的重要框架,其1.0版本通过分层架构设计实现了模块化开发,显著提升了智能体开发效率。底层标准化接口(LLM、Retrieval、Memory)构建基础能力,中间层通过Runnable协议实现组件化编排,上层LCEL提供声明式编程能力。这种架构不仅简化了开发流程,还优化了调试体验和生产部署。在实际应用中,LangChain 1.0的可观测性体系(全链路追踪、可视化调试器)和性能优化策略(异步处理、缓存机制)大幅提升了开发效率和系统性能。特别适用于电商客服、金融数据分析等需要复杂AI能力集成的场景。