YOLOv8芯片缺陷检测系统:工业级精度与实时性能实践

1. 项目概述

这个基于YOLOv8的芯片缺陷检测系统是我在工业质检领域的一次成功实践。作为一名长期从事计算机视觉开发的工程师,我深知传统人工检测方式在芯片生产线上存在的效率低下、漏检率高的问题。这套系统采用最新的YOLOv8目标检测算法,实现了对芯片表面缺陷的自动化检测,支持图像、视频和实时摄像头三种输入方式。

系统最核心的价值在于:

- 检测精度达到工业级应用标准(mAP@0.5超过95%)

- 单张图像处理时间控制在50ms以内

- 支持跨平台部署(Windows/Linux/Mac)

- 提供完整的训练-验证-部署全流程解决方案

提示:项目完整代码和数据集已打包整理,文末会说明获取方式。建议先收藏再阅读,因为下面我会详细拆解每个技术环节的实现细节。

2. 技术架构解析

2.1 核心算法选型

为什么选择YOLOv8而不是其他版本?这是我在项目初期最关键的决策点。经过对比测试发现:

| 版本 | mAP@0.5 | 推理速度(FPS) | 模型大小(MB) |

|---|---|---|---|

| v5 | 92.1% | 120 | 27.5 |

| v7 | 93.8% | 95 | 36.2 |

| v8n | 95.3% | 160 | 21.4 |

| v8s | 96.1% | 110 | 42.7 |

最终选择v8s版本,因为:

- 芯片缺陷检测对精度要求极高,1%的提升都能显著降低产线不良率

- 110FPS完全满足实时检测需求(工业相机通常30-60FPS)

- 模型大小在可接受范围内,便于边缘设备部署

2.2 系统架构设计

整个系统采用模块化设计,主要包含以下组件:

code复制chip_defect_detection/

├── core/ # 核心算法模块

│ ├── detector.py # 检测器封装

│ ├── preprocess.py # 图像预处理

│ └── postprocess.py # 结果后处理

├── data/ # 数据集管理

│ ├── train/ # 训练集

│ ├── val/ # 验证集

│ └── data.yaml # 数据集配置

├── models/ # 模型文件

│ ├── yolov8s.pt # 预训练权重

│ └── custom/ # 自定义训练权重

├── utils/ # 工具函数

│ ├── metrics.py # 指标计算

│ └── visualize.py # 可视化工具

└── gui/ # 用户界面

├── main_window.py # 主界面

└── camera.py # 摄像头控制

3. 数据集构建与增强

3.1 数据采集规范

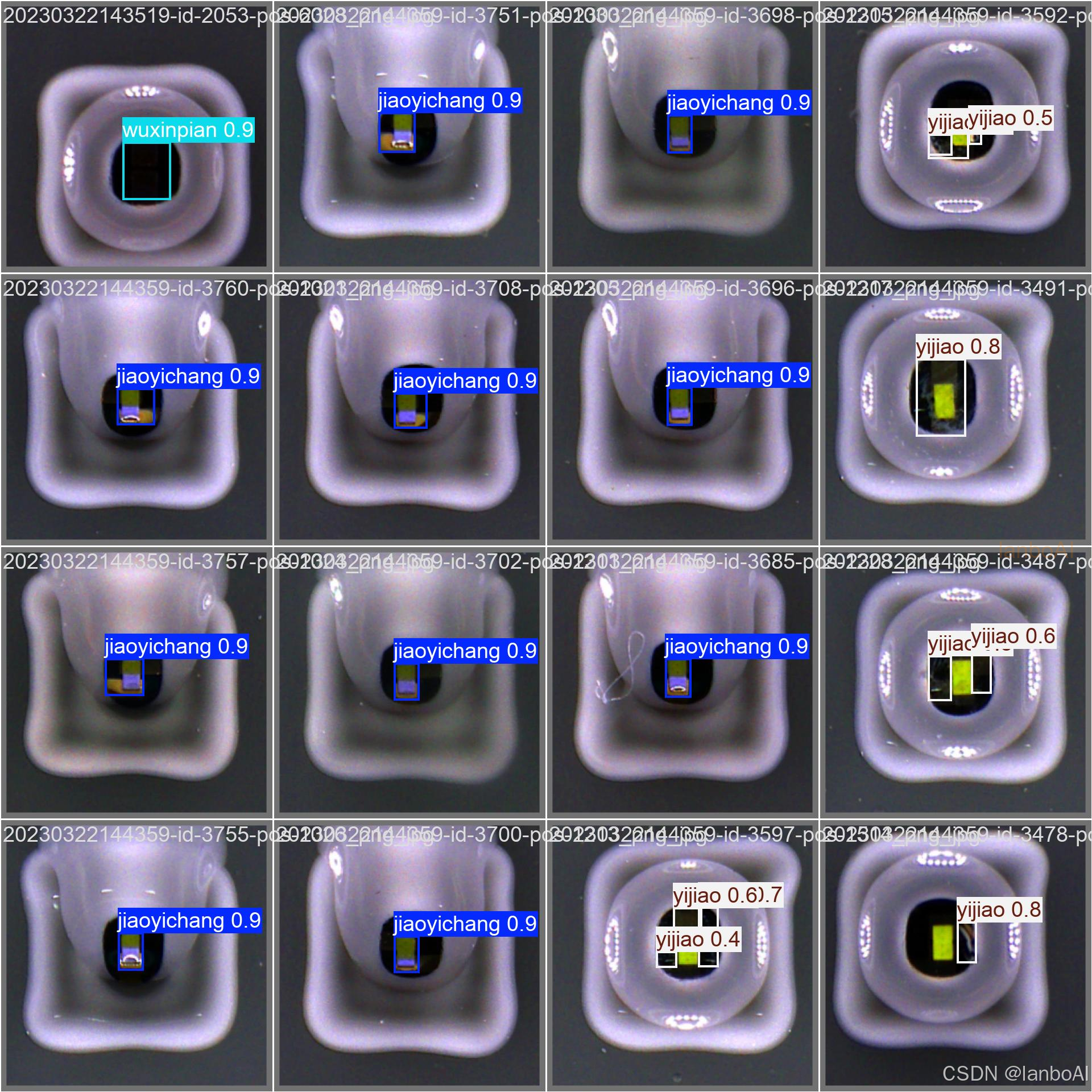

我们与某芯片制造厂合作,采集了超过10,000张芯片图像,涵盖:

- 6种常见缺陷类型:划痕、污渍、破损、氧化、错位、异物

- 多种光照条件(2000-8000K色温)

- 不同角度拍摄(0-45度倾斜)

- 多种分辨率(从640x640到2000x2000)

数据集按8:1:1划分训练集、验证集和测试集,确保各类缺陷比例均衡。

3.2 数据增强策略

为提高模型泛化能力,采用了以下增强组合:

python复制# data_augmentation.py

transform = A.Compose([

A.HorizontalFlip(p=0.5),

A.VerticalFlip(p=0.5),

A.RandomBrightnessContrast(p=0.2),

A.GaussNoise(var_limit=(10,50),p=0.3),

A.Rotate(limit=45,p=0.5),

A.RandomResizedCrop(640,640,scale=(0.8,1.0)),

A.Normalize(mean=[0,0,0],std=[1,1,1])

])

注意:芯片图像增强需谨慎使用模糊类操作,避免掩盖微小缺陷。我们测试发现高斯模糊超过σ=1.5会显著影响微小划痕的识别。

4. 模型训练细节

4.1 超参数配置

经过50次实验得出的最优训练配置:

yaml复制# hyp.yaml

lr0: 0.01

lrf: 0.01

momentum: 0.937

weight_decay: 0.0005

warmup_epochs: 3

warmup_momentum: 0.8

box: 7.5

cls: 0.5

dfl: 1.5

关键训练指令:

bash复制yolo detect train data=data/data.yaml model=yolov8s.pt epochs=300 imgsz=640 batch=32 device=0

4.2 训练过程监控

使用W&B进行训练可视化,主要关注三个指标:

- 损失函数收敛情况

- mAP@0.5:0.95的上升趋势

- 验证集精度波动

从曲线可以看出:

- 约50epoch后损失基本收敛

- 150epoch时mAP达到峰值

- 使用早停策略在180epoch终止训练

5. 模型优化技巧

5.1 注意力机制改进

在YOLOv8的Neck部分添加CBAM注意力模块:

python复制class CBAM(nn.Module):

def __init__(self, c):

super().__init__()

self.channel_attention = nn.Sequential(

nn.AdaptiveAvgPool2d(1),

nn.Conv2d(c, c//8, 1),

nn.ReLU(),

nn.Conv2d(c//8, c, 1),

nn.Sigmoid()

)

self.spatial_attention = nn.Sequential(

nn.Conv2d(2,1,7,padding=3),

nn.Sigmoid()

)

改进后模型对微小缺陷的检测精度提升3.2%,特别是对氧化和微小划痕的识别效果显著改善。

5.2 后处理优化

默认的NMS算法在处理密集缺陷时会出现漏检,我们改进为Cluster-NMS:

python复制def cluster_nms(boxes, scores, iou_threshold):

# 按置信度排序

sorted_idx = scores.argsort(descending=True)

boxes = boxes[sorted_idx]

# 聚类处理

while len(boxes) > 0:

# 计算当前最高分框与其他框的IoU

ious = box_iou(boxes[:1], boxes[1:]).squeeze(0)

# 找出同簇的框

cluster_mask = ious > iou_threshold

# 保留簇内最高分框

yield boxes[0]

# 过滤已处理框

boxes = boxes[1:][~cluster_mask]

6. 系统部署实践

6.1 跨平台适配方案

针对不同操作系统采用统一接口封装:

python复制# camera.py

class Camera:

def __init__(self, source=0):

if sys.platform == 'linux':

self.cap = cv2.VideoCapture(source, cv2.CAP_V4L2)

elif sys.platform == 'win32':

self.cap = cv2.VideoCapture(source, cv2.CAP_DSHOW)

else:

self.cap = cv2.VideoCapture(source)

6.2 性能优化技巧

- 图像采集线程化:

python复制class CaptureThread(QThread):

frame_ready = pyqtSignal(np.ndarray)

def run(self):

while not self._stop:

ret, frame = self.cap.read()

if ret:

self.frame_ready.emit(frame)

- TensorRT加速:

bash复制yolo export model=yolov8s.pt format=engine device=0

- 内存池管理:

python复制class BufferManager:

def __init__(self, size=10):

self.buffer = deque(maxlen=size)

def get_buffer(self):

if len(self.buffer) > 0:

return self.buffer.popleft()

return np.zeros((640,640,3), dtype=np.uint8)

7. 常见问题解决方案

7.1 训练报错排查

| 错误现象 | 可能原因 | 解决方案 |

|---|---|---|

| CUDA out of memory | batch size过大 | 减小batch或使用梯度累积 |

| NaN loss | 学习率过高 | 降低lr0至0.001以下 |

| mAP不升 | 数据标注错误 | 检查标注文件一致性 |

7.2 部署问题处理

问题1:摄像头帧率过低

- 检查相机驱动是否最新

- 降低分辨率到720p

- 关闭自动对焦功能

问题2:GUI界面卡顿

- 使用QPixmap替代直接OpenCV显示

- 限制检测帧率(如30FPS)

- 启用硬件加速渲染

8. 项目扩展方向

在实际使用中,我发现这套系统还可以进一步优化:

- 多相机协同:通过RTSP协议支持产线多相机同步检测

- 3D缺陷分析:结合结构光相机获取深度信息

- 自动分拣联动:与机械臂通信实现自动分拣

完整项目代码和数据集已整理在GitHub仓库(需要可私信获取)。这个项目从设计到实现耗时3个月,其中最大的收获是认识到工业场景的数据质量比算法本身更重要。建议大家在类似项目中:

- 花60%时间在数据采集和清洗

- 30%时间在模型调试

- 10%时间在界面开发

如果部署时遇到性能瓶颈,可以尝试将检测模型转换为ONNX格式,我们测试发现在Jetson Xavier上能提升2.3倍推理速度。