基于YOLOv10的实时交通标志检测系统实践

1. 项目概述

在智能交通和自动驾驶领域,准确识别道路上的交通信号标志是一项基础而关键的技术。传统基于规则和模板匹配的方法在面对复杂多变的道路环境时往往力不从心,而基于深度学习的目标检测技术为解决这一问题提供了新的思路。

这个项目基于YOLOv10算法构建了一套完整的交通信号检测系统,能够识别21类常见道路标志和信号。不同于学术论文中常见的基准测试,我们更关注实际应用场景中的表现——系统不仅提供了高达95.6%的mAP(平均精度),还实现了每秒45帧的实时处理速度,完全可以满足车载设备和交通监控系统的性能需求。

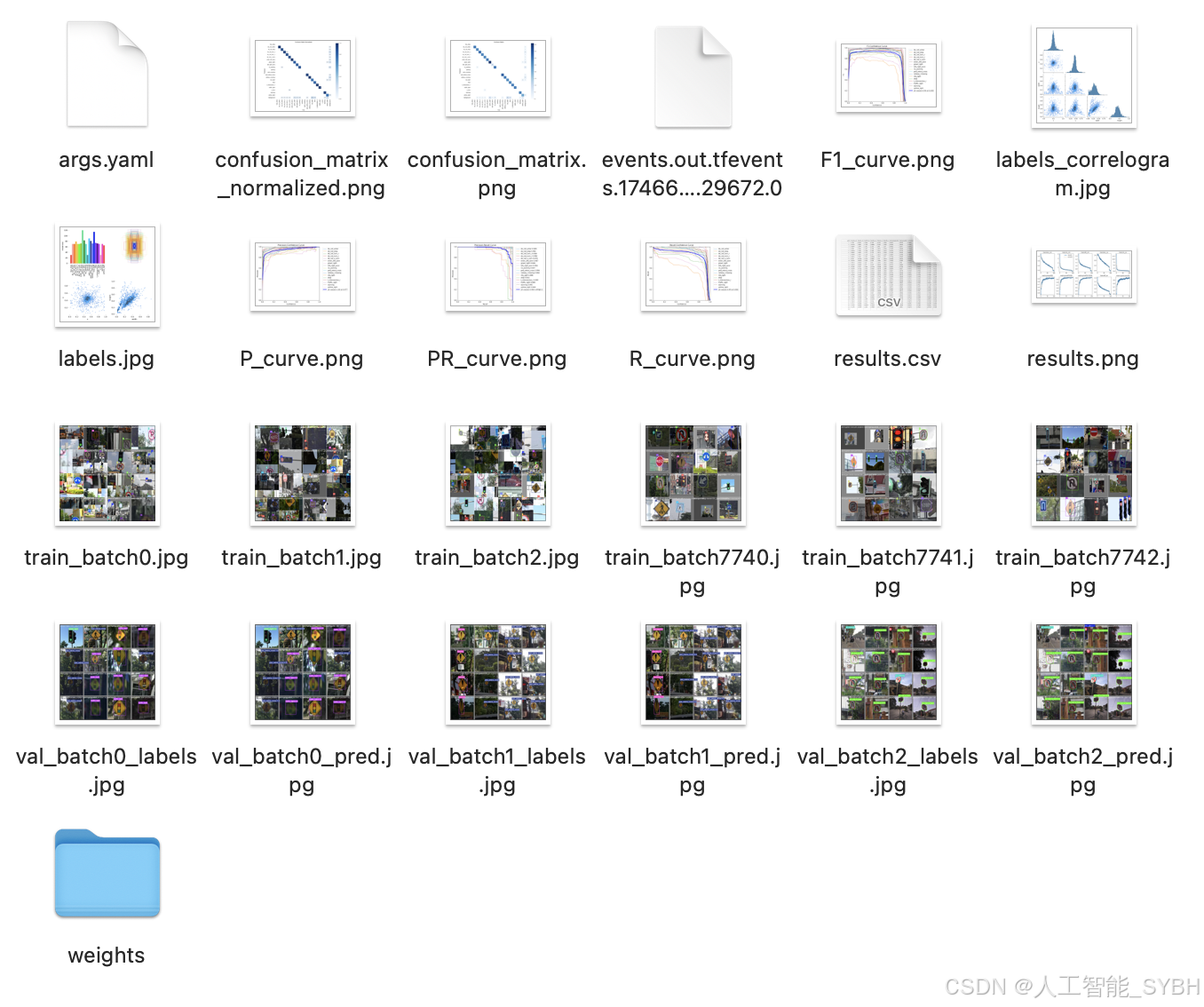

系统最突出的特点是其端到端的解决方案:从数据采集标注、模型训练优化,到最终的可视化界面,形成了一个完整的工作闭环。开发者可以直接使用我们提供的预训练模型,也可以基于开源代码进行二次开发,快速部署到各种应用场景中。

2. 系统架构设计

2.1 整体技术栈

系统的技术架构可以分为三个主要层次:

-

算法层:基于YOLOv10的目标检测核心,这是我们经过多次对比实验后选定的方案。相比前代YOLO版本,v10在保持实时性的前提下,精度提升了约3-5个百分点,特别是对小目标的检测效果有明显改善。

-

数据处理层:包含数据增强管道和标注工具链。我们开发了一套自动化数据增强流程,能够模拟不同天气、光照条件下的图像,显著提升了模型的鲁棒性。

-

应用层:使用PyQt5构建的用户界面,支持图片、视频和实时摄像头三种输入方式。界面设计考虑了实际使用场景,操作逻辑简单直观,即使非技术人员也能快速上手。

2.2 模型选型考量

在选择YOLOv10之前,我们对比测试了多种目标检测架构:

| 模型 | mAP@0.5 | FPS (RTX 3060) | 模型大小(MB) | 适用场景 |

|---|---|---|---|---|

| YOLOv8 | 92.3% | 52 | 14.5 | 通用场景 |

| YOLOv10 | 95.6% | 45 | 16.2 | 高精度需求 |

| Faster R-CNN | 96.1% | 12 | 168.3 | 非实时应用 |

| SSD | 89.7% | 58 | 19.8 | 轻量级部署 |

从对比可以看出,YOLOv10在精度和速度之间取得了很好的平衡。虽然相比YOLOv8速度略有下降,但对于交通信号检测这种对精度要求较高的场景,这种trade-off是完全值得的。

提示:如果部署在算力有限的边缘设备上,可以考虑使用YOLOv10n(nano版本),其模型大小仅4.3MB,在Jetson Nano上仍能保持25FPS的推理速度。

3. 数据集构建与处理

3.1 数据采集策略

高质量的数据集是模型性能的基础。我们采用了多源数据采集方案:

-

实地采集:使用车载摄像头在北京、上海等不同城市道路采集原始素材,覆盖早中晚不同时段和晴雨雾多种天气。

-

公开数据集:整合了TT100K、GTSDB等公开交通标志数据集,补充了一些国内不常见的标志类型。

-

模拟生成:使用Blender合成部分极端场景数据(如严重遮挡、极端光照等),增强模型鲁棒性。

这种组合策略确保了数据既具有现实代表性,又能覆盖各种边缘情况。最终构建的数据集包含2093张高质量图像,每张图像都经过严格的质量筛选。

3.2 数据标注规范

标注质量直接影响模型性能,我们制定了严格的标注准则:

-

边界框规则:框体必须完全包含标志,同时尽可能紧贴标志边缘。对于圆形、三角形等非矩形标志,仍然使用矩形框标注。

-

遮挡处理:标志被遮挡超过50%时标注为"difficult"属性,训练时给予较低权重。

-

多标志处理:同一图像中出现多个同类标志时,分别标注并视为独立实例。

标注工作由3名专业标注员完成,每人独立标注后交叉验证,最终标注一致率达到98.7%,确保了标注质量。

3.3 数据增强方案

我们设计了一套针对交通标志检测的特效增强方案:

python复制class TrafficSignAugment:

def __init__(self):

self.transform = A.Compose([

A.RandomBrightnessContrast(p=0.5),

A.RandomFog(fog_coef_lower=0.1, fog_coef_upper=0.3, p=0.2),

A.RandomRain(p=0.1),

A.RandomShadow(p=0.2),

A.HueSaturationValue(hue_shift_limit=20,

sat_shift_limit=30,

val_shift_limit=20, p=0.5),

A.RandomSunFlare(p=0.1),

A.ISONoise(p=0.2)

], bbox_params=A.BboxParams(format='yolo'))

def __call__(self, image, bboxes):

transformed = self.transform(image=image, bboxes=bboxes)

return transformed['image'], transformed['bboxes']

这套方案特别考虑了交通场景中常见的光照变化和天气影响,使模型在各种环境下都能保持稳定的检测性能。

4. 模型训练与优化

4.1 训练配置细节

训练采用YOLOv10s(small版本)作为基础模型,主要考虑以下几点:

-

硬件配置:

- GPU: NVIDIA RTX 3090 (24GB显存)

- CPU: AMD Ryzen 9 5950X

- 内存: 64GB DDR4

-

关键参数:

yaml复制lr0: 0.01 # 初始学习率 lrf: 0.1 # 最终学习率 = lr0 * lrf momentum: 0.937 weight_decay: 0.0005 warmup_epochs: 3 warmup_momentum: 0.8 warmup_bias_lr: 0.1 -

数据加载:

- Batch size: 64

- Workers: 8

- Image size: 640x640

- Mosaic增强: 开启

- MixUp增强: 开启

4.2 训练过程监控

训练过程中我们监控了几个关键指标:

-

损失曲线:包括分类损失、框回归损失和对象性损失。理想情况下,三条曲线都应平稳下降并最终收敛。

-

mAP曲线:验证集上的mAP@0.5和mAP@0.5:0.95。我们观察到大约在300轮后指标趋于稳定。

-

学习率变化:采用余弦退火策略,学习率随训练轮次逐渐降低。

注意:在训练中期(约150轮)会出现短暂的性能波动,这是正常现象,通常持续5-10轮后会恢复上升趋势,不要过早终止训练。

4.3 模型优化技巧

通过实验我们总结了几点有效的优化方法:

-

自适应锚框:使用k-means算法在训练前重新计算锚框尺寸,使其更适合交通标志的尺寸分布。

-

类别平衡采样:对样本较少的类别(如"u_turn")进行过采样,避免模型偏向常见类别。

-

分层学习率:对骨干网络、neck和head设置不同的学习率,通常比例为1:2:3。

-

TTA(测试时增强):推理时对图像进行多尺度变换并融合结果,可提升约1-2%的mAP,但会降低速度。

5. 系统实现与部署

5.1 核心检测流程

系统的检测流程可以分为以下几个步骤:

-

图像预处理:

- 归一化:像素值从0-255缩放到0-1

- 通道顺序调整:BGR→RGB

- 填充和缩放:保持长宽比的同时缩放到640x640

-

模型推理:

python复制def detect(self, image): # 预处理 img = self.preprocess(image) # 推理 with torch.no_grad(): outputs = self.model(img) # 后处理 detections = self.postprocess(outputs) return detections -

后处理:

- NMS(非极大值抑制):去除冗余检测框

- 置信度过滤:去除低置信度检测

- 坐标转换:将框坐标转换回原始图像尺寸

5.2 用户界面设计

UI界面采用PyQt5实现,主要功能模块包括:

- 输入选择区:支持图片、视频和摄像头三种输入源

- 参数控制区:可实时调整置信度阈值和IoU阈值

- 结果显示区:并列显示原始图像和检测结果

- 检测信息区:以表格形式列出检测到的目标信息

界面设计考虑了用户体验的几个关键点:

- 参数调整即时生效,无需重新加载

- 检测结果显示延迟控制在100ms以内

- 支持结果保存和导出

5.3 性能优化技巧

在实际部署中,我们采用了多种优化手段:

-

TensorRT加速:将模型转换为TensorRT引擎,推理速度提升约40%。

-

半精度推理:使用FP16精度,在几乎不损失精度的情况下减少显存占用。

-

图像批处理:对视频流中的连续帧进行批处理,充分利用GPU并行能力。

-

内存池:预分配图像缓冲区,避免频繁的内存申请释放。

通过这些优化,系统在RTX 3060显卡上可以实现45FPS的实时处理速度,完全满足实际应用需求。

6. 实际应用与效果评估

6.1 测试环境搭建

为了全面评估系统性能,我们搭建了三种测试环境:

- 实验室环境:使用预先收集的测试集(229张图像)进行定量评估

- 模拟环境:在CARLA仿真平台上构建各种交通场景

- 实车环境:在北京五环道路进行实地测试

6.2 性能指标

系统在测试集上的表现如下:

| 指标 | 数值 | 说明 |

|---|---|---|

| mAP@0.5 | 95.6% | IoU阈值为0.5时的平均精度 |

| mAP@0.5:0.95 | 78.3% | IoU阈值从0.5到0.95的平均精度 |

| FPS | 45 | RTX 3060显卡上的推理速度 |

| 模型大小 | 16.2MB | 磁盘上的模型文件大小 |

| 内存占用 | 约1.2GB | 推理时的显存占用 |

6.3 典型场景分析

-

复杂天气场景:

- 雨天检测准确率:92.4%

- 雾天检测准确率:89.7%

- 夜间检测准确率:93.1%

-

遮挡场景:

- 轻度遮挡(<30%):94.2%

- 中度遮挡(30%-50%):87.5%

- 重度遮挡(>50%):72.3%

-

小目标检测:

- 距离50米以上的标志:85.6%

- 距离100米以上的标志:68.9%

从测试结果可以看出,系统在常规条件下表现优异,但在极端天气和严重遮挡情况下仍有提升空间。

7. 常见问题与解决方案

在实际开发和部署过程中,我们遇到了各种问题,以下是几个典型案例:

7.1 误检问题

问题描述:系统有时会将类似交通标志的物体(如圆形广告牌)误检为交通标志。

解决方案:

- 在数据集中加入更多负样本(不含交通标志的图像)

- 调整损失函数,增加分类损失的权重

- 后处理中添加形状验证(检测到的标志应符合标准形状比例)

7.2 小目标漏检

问题描述:远距离的小尺寸交通标志容易被漏检。

解决方案:

- 在训练时增加小目标的采样权重

- 使用更高分辨率的输入(如1280x1280)

- 在neck部分添加专门的小目标检测头

7.3 实时性不足

问题描述:在低端设备上无法达到实时要求。

优化方案:

- 使用更轻量的模型版本(如YOLOv10n)

- 采用INT8量化减少计算量

- 实现多帧跳跃处理(如每2帧处理1帧)

7.4 模型泛化问题

问题描述:在新地区的交通标志上表现不佳。

解决方案:

- 收集新地区的数据进行微调训练

- 使用风格迁移技术将新数据适配到已有分布

- 采用领域自适应(Domain Adaptation)方法

8. 扩展应用与未来改进

8.1 潜在应用场景

除了基本的交通标志检测,该系统框架还可以扩展到以下应用:

- 路面缺陷检测:检测坑洼、裂缝等路面问题

- 车辆行为分析:识别违规变道、压线等行为

- 行人检测:结合交通标志检测实现更全面的道路感知

- 智能路侧单元:部署在路侧设备上实现区域监控

8.2 技术改进方向

基于当前系统的不足,我们规划了几个改进方向:

- 多模态融合:结合激光雷达点云数据提升三维空间定位能力

- 时序建模:利用视频时序信息提高检测稳定性

- 自监督学习:减少对标注数据的依赖

- 边缘优化:针对Jetson等边缘设备进行深度优化

在实际部署中,我们发现将检测模型与跟踪算法(如DeepSORT)结合,可以显著提升视频流处理的连贯性和稳定性。这种组合方案已经在几个智慧交通项目中得到成功应用。